姓名:周易

职称:教授,博士生导师

邮箱:eeyzhou@hnu.edu.cn

个人学术主页:https://scholar.google.com/citations?user=_21IqnsAAAAJ&hl=en

实验室主页:https://sites.google.com/view/zhouyi-joey/home

基本情况

周易,男,教授,博导。2018年于澳大利亚国立大学工程与计算机学院取得博士学位,入选国家高水平青年人才计划。主要从事基于先进视觉传感器的机器人感知与导航技术研究,包括高速自主机器人技术、视觉里程计(VO/SLAM)、动态视觉传感器 (Event-based Vision),多视角几何理论等。主要科研成果发表在IEEE T-RO,RSS,ECCV等机器人与计算机视觉的权威刊物,目前担任IEEE RA-L副主编。

教育与工作经历

2021.10 – 今, 欧洲杯竞猜·(中国)官方网站,教授

2019.10 – 2021.10 香港科技大学电子与计算机工程系,博士后

2018.6 – 2019.9 魔视智能(上海)科技有限公司,定位与建图(SLAM)算法负责人

2017.9 – 2018.3 瑞士苏黎世联邦理工(ETH Zurich)访问学者,NCCR Fellow

2014.8 – 2018.6 澳大利亚国立大学,工程与计算机科学,博士

2012.8 – 2014.8 北京航空航天大学,高等工程学院,机械电子工程,博士研究生

2008.9 – 2012.7 北京航空航天大学,机械工程及自动化学院,飞行器制造,本科

研究方向

视觉里程计(VO)

同时定位和建立地图(SLAM)

3D 计算机视觉

仿神经形态学的动态视觉传感(Dynamic Vision Sensor,e.g., Event-based Camera)

科研队伍简介

湖南大学神经形态自动化与智能实验室(NAIL)专注于探索先进视觉传感器

技术以及其在自主移动机器人系统中的应用,旨在解决复杂且极具挑战性工况(如高速场景、非结构化环境、高动态区间光照等)下移动机器人的感知、状态估计和控制等科学和工程问题。相关应用包括微型无人机(mUAV)GNC、智能辅助驾驶、虚拟现实/增强现实(VR/AR)、航天监视和操纵、工业自动化等。

近年来,团队在基于类神经形态视觉传感器(事件相机)的移动机器人关键技术的研究取得了若干原创性成果和突破,其中代表性工作包括:

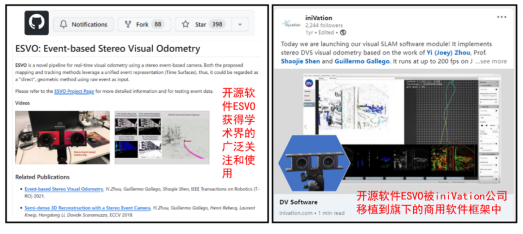

1)提出并开源了世界上首款基于双目事件相机的三维重建与视觉里程计算法,成果发表于IEEE Transaction on Robotics 2021,开源项目受到业界领头羊企业瑞士公司iniVation的官方报道,并被纳入到其商用软件框架钟;

2)提出的基于事件相机与IMU的高速移动机器人状态估计方法被Robotics: Science and System (RSS)2024收录,为湖南大学校史首篇RSS论文!(https://news.hnu.edu.cn/info/1102/41667.htm)

3)提出的基于事件相机的碰撞时间检测方法和面向事件数据的一般性几何模型拟合方法均被ECCV 2024收录,成果被学校官网报道(https://news.hnu.edu.cn/info/1102/41862.htm)

开设课程

本科生:《移动机器人》 64学时;《机器人工程高级实践》128学时

研究生:《无人机建模与控制》32学时

招聘

1)博士后: 毕业于双一流高校或一流学科的博士研究生;获得博士学位一般在3年内;具有良好的科研潜质、学术道德和综合能力;全职在校从事研究工作;在国际机器人、计算机视觉会议和期刊上发表过论文;有丰富工程经验。

(http://mve.hnu.edu.cn/info/1044/10489.htm)

2)研究助理:有丰富工程经验,具备课题组研究相关的技能

招生

扎实的数理、编程基础,参与过科研项目(或接受过专业课程培训,如深蓝学院网上课程,并获得优秀证书)

1)博士:毕业于双一流高校或一流学科的硕士研究生或直博生 ;扎实的数理、编程基础,参与过科研项目(或接受过专业课程培训并获得优秀证书,如深蓝学院课程),对课题组研究感兴趣,励志深耕于移动机器人、计算机视觉相关领域;

2)硕士:毕业于双一流高校或一流学科的本科 ;扎实的数理、编程基础,对课题组研究感兴趣;

3)本科实习生:本校计算机、机器人、自动化相关专业本科生。

代表性论文

[1] Yi Zhou, Guillermo Gallego, Shaojie Shen. Event-based Stereo Visual Odometry. IEEE Transactions on Robotics (Volume: 37,Issue: 5, Oct. 2021).

[2] Yi Zhou, Hongdong Li, and Laurent Kneip. Canny-VO: Visual Odometry with RGB-D Cameras Based on Geometric 3-D–2-DEdge Alignment. IEEE Transactions on Robotics (Volume: 35, Issue: 1, Feb. 2019): 184-199.

[3]Yi Zhou, Guillermo Gallego, Xiuyuan Lu, Siqi Liu, Shaojie Shen. Event-based MotionSegmentation with Spatio-Temporal Graph Cuts. IEEE Transactions on Neural Networks and Learning Systems (Volume: 34, Issue: 8, Aug. 2023).

[4] Yi Zhou, Guillermo Gallego, Henri Rebecq, Laurent Kneip, Hongdong Li, Davide Scaramuzza. Semi-dense 3d reconstruction with a stereo event camera. In Proceedings of the European Conference on Computer Vision (ECCV), pp. 235-251. 2018.

[5]Xiuyuan Lu*, Yi Zhou*,Junkai Niu, Sheng Zhongand Shaojie Shen. Event-based Visual-Inertial Velometer.InRobotics: Science and Systems(RSS)2024.

[6] Jinghang Li, Bangyan Liao,Xiuyuan Lu, Peidong Liu, Shaojie Shen,Yi Zhou…. Event-Aided Time-to-Collision Estimation for Autonomous Driving.In Proceedings of the European Conference on Computer Vision (ECCV),2024.

[7] ZhongyangRen, Bangyan Liao,Delei Kong, Jinghang Li, Peidong Liu, Laurent Kneip, Guillermo Gallego,Yi Zhou….Motion and Structure from Event-based Normal Flow.In Proceedings of the European Conference on Computer Vision (ECCV),2024.

[8]Junkai Niu, Sheng Zhong, Yi Zhou…. IMU-Aided Event-based Stereo Visual Odometry. The 2024 IEEE International Conference on Robotics and Automation (ICRA).

在顶级会议CVPR 2021上做Tutorial报告:

ATutorial on Event-based Visual Odometry. Courtesy presentation at the 3rdEvent-based Vision Workshop in CVPR 2021.